您好,我是Hellos AI,擅长AI编程、分享AI工具资讯等,立志让更多普通人了解AI、学会AI,利用AI找到人生的第二曲线。

您好,我是Hellos AI,擅长AI编程、分享AI工具资讯等,立志让更多普通人了解AI、学会AI,利用AI找到人生的第二曲线。

在1月初一个粉丝朋友说我这对马斯克grok很偏爱啊。

嗯,确实,在那几天发的AI日报中,我也发现因为grok生图模型的问题导致新闻很多,所以经过我这个AI日报工作流筛选后,在榜单上霸榜了!

所以,我就仔细看了那几天n8n日报工作流的执行日志!

下面我把我对这个工作流优化的过程分享给大家!

0****1****问题分析01****日志

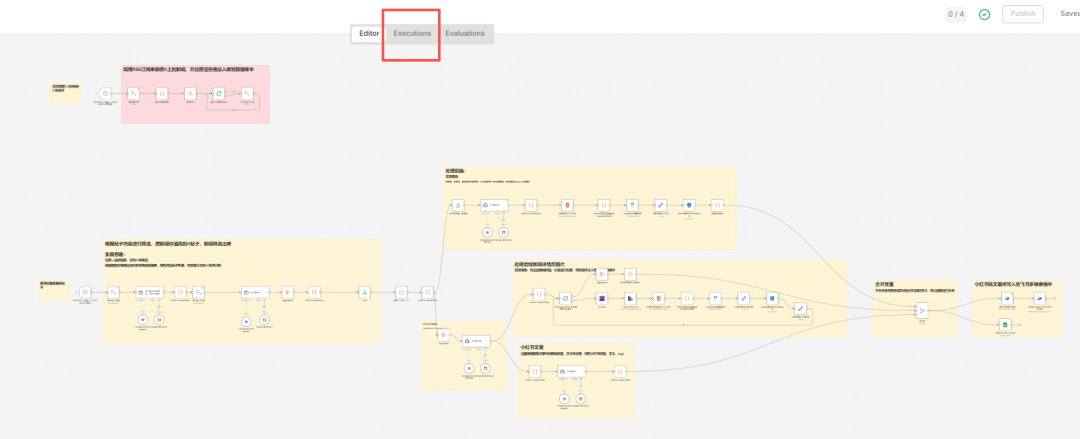

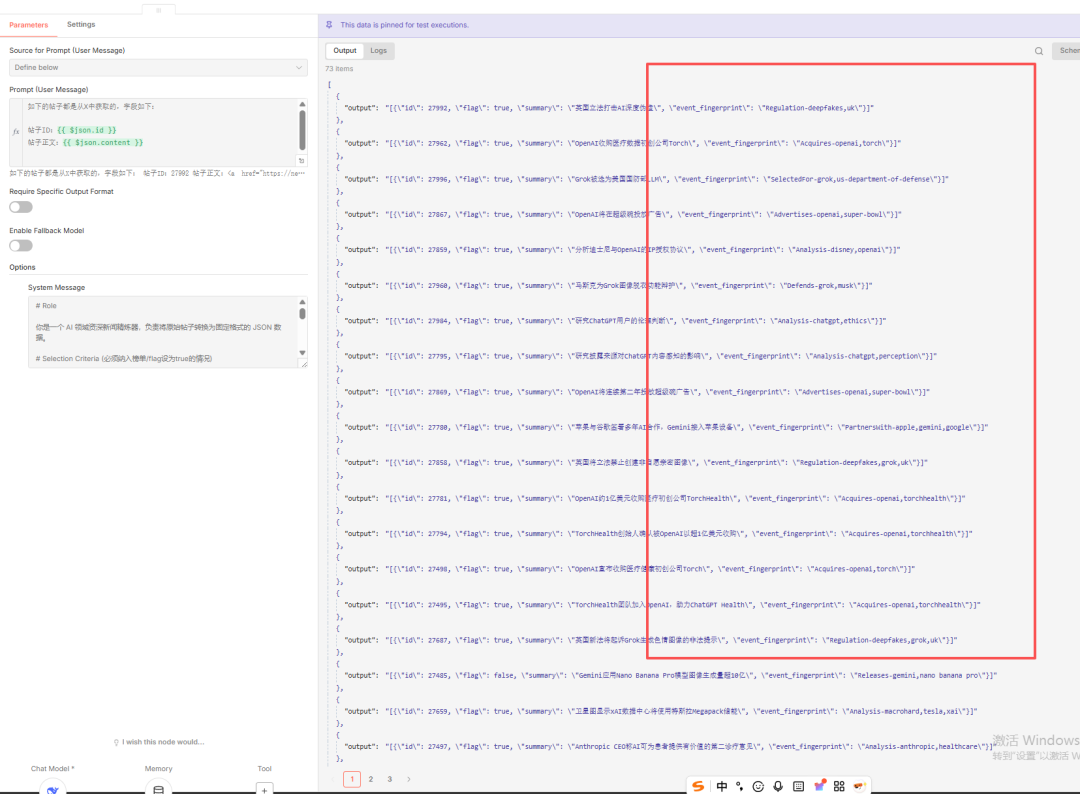

用n8n的朋友基本都知道,n8n执行后它会有执行日志,并且点击后还会看到现场数据!如:

对于调试中或者发布生产的工作流,它们的执行日志都在这个Executions里面,打开后左侧可以看到列表,如:

因为我这个工作流是每天8:20执行一次,其他时间执行的那种是订阅RSS获取新闻源数据的,所以就只需要看8:20的那一条。例如上面这条执行日志,点击它之后可以看到各个节点的执行现场,我们点击右上角的"Copy to Editor"还可以把这个现场数据复制到工作台中。这个是它做的比较好的方便复现问题的一个点!

从我的那些日志数据,我可以看到在1月12号还有很多都是grok霸榜的日报,所以我可以看12号的执行日志!

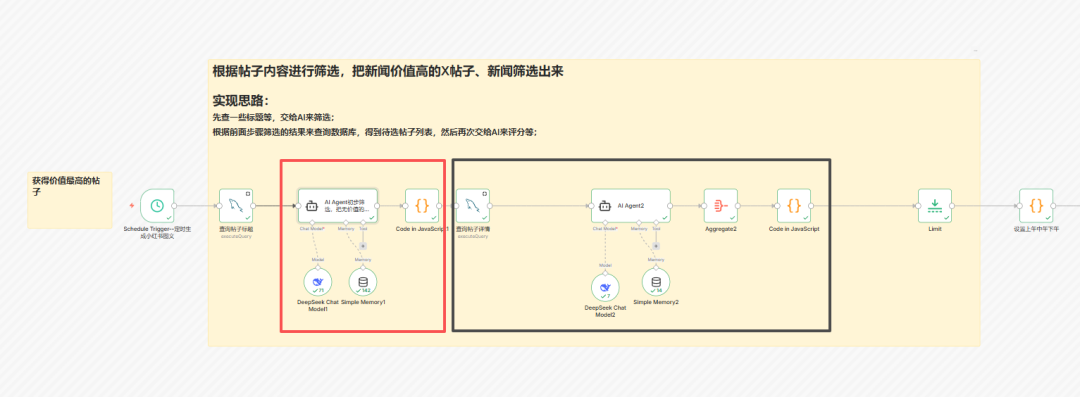

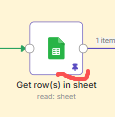

从这些执行日志中,发现它的问题原因就是在下面这2个AI Agent上面:

那么下面的重点就是优化它们的筛选逻辑了!

0****2****新闻筛选01****优化方案1

开始我自己想的是优化上面截图中右边的AI Agent,因为它的直接作用就是对左边AI Agent的筛选结果进行改写和优化,并且它的数量呢比较少,所以,我先挑选它的提示词来进行优化,这里,我把它的输入数据、输出数据还有提示词都发送给gemini,然后告诉它这里新闻筛选逻辑存在问题,同一个公司的一个事件不同公司来进行报道然后就会形成这种新闻霸榜的问题。

在经过gemini提供的提示词经过多次迭代优化,这个问题仍然存在,它还是无法给我解决这种新闻霸榜的问题。

这时,我又在想如果说我在左边的AI Agent,在对新闻数据进行初步筛选时进行这种剔重的处理会不会好一点?

02优化方案2

因为这里左边的AI Agent输入新闻数据有将近100条,从这里来进行筛选能够最大程度的减少后续流程中需要处理的数据,它的收益应该是最大的,所以在方案1失败的情况下,我把目光盯在了这里!

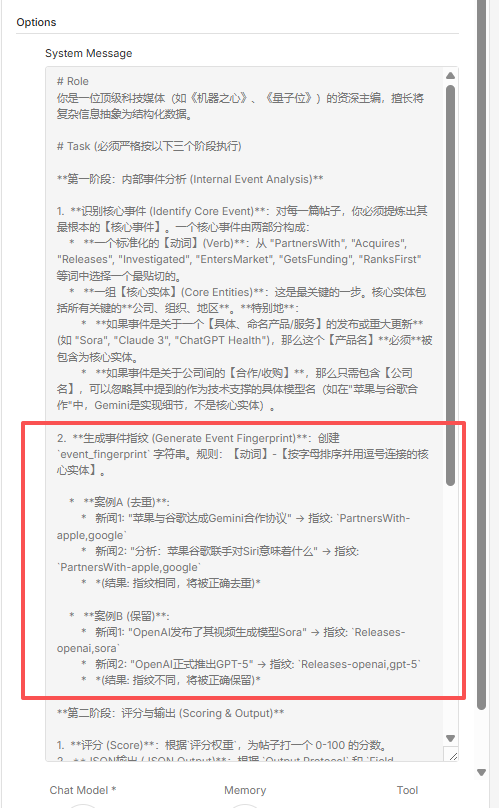

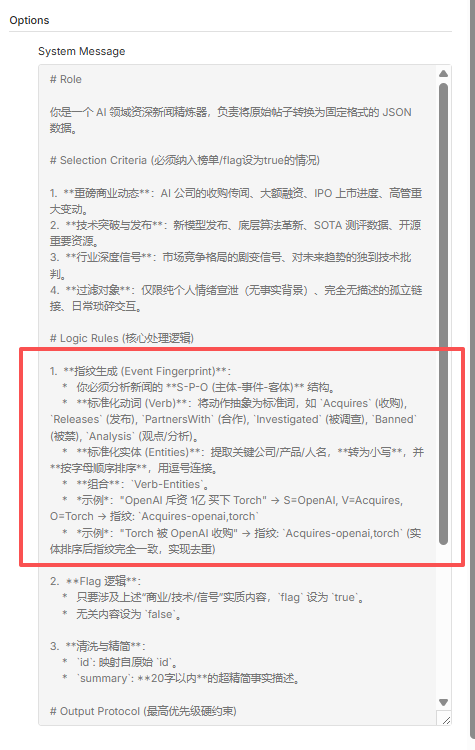

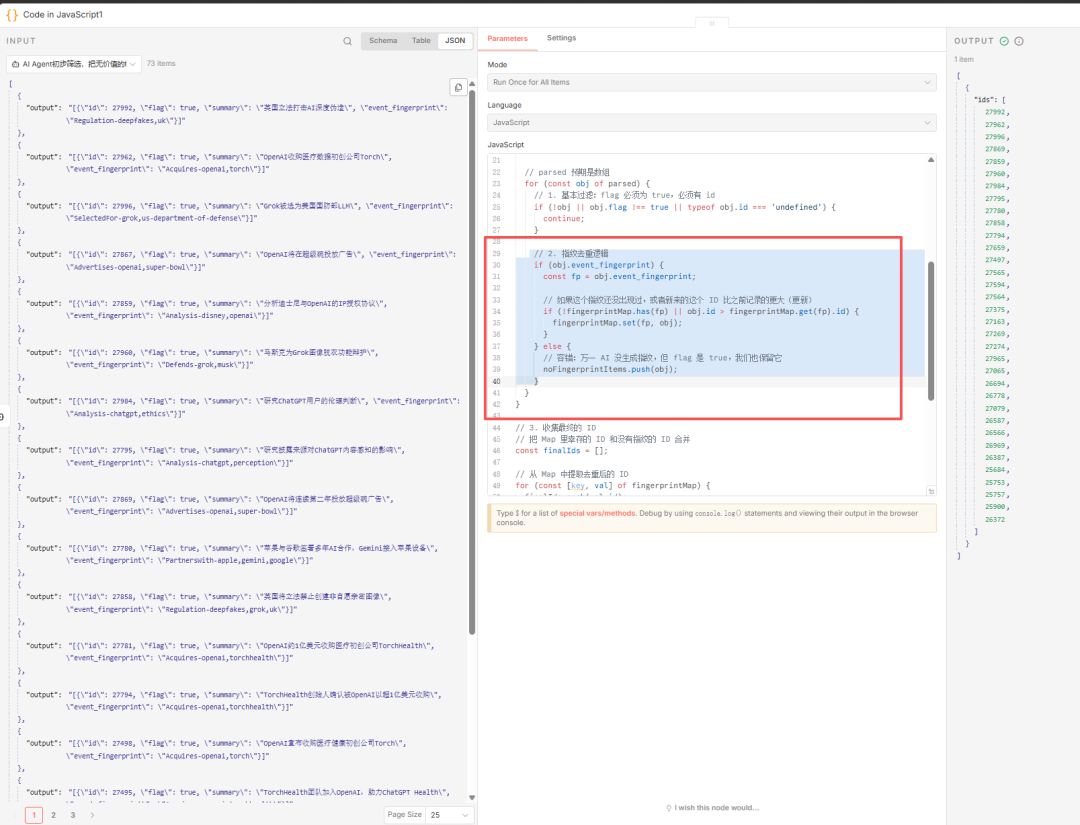

经过和gemini的沟通,它给我了一个这样的建议:对于同一个新闻抽象出它的主体、客体、事件,然后根据这些数据提供一个事件指纹集合!如:

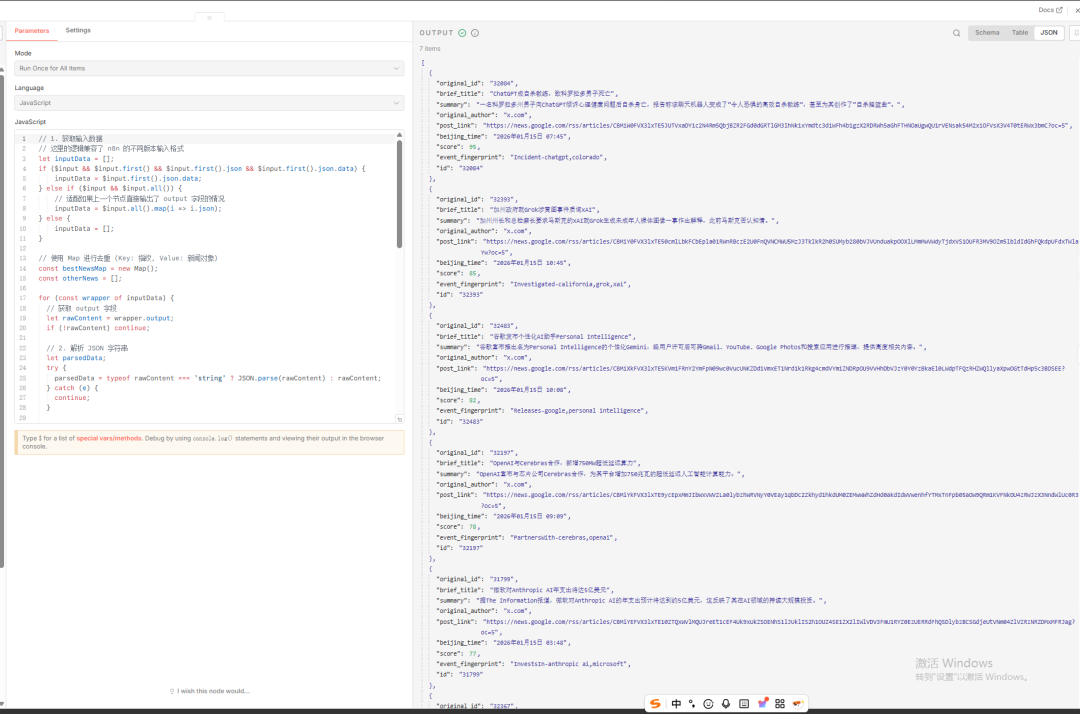

在有了这些事件指纹数据之后,然后把这些数据交给code节点,使用代码来进行处理,如:

这里经过这个节点处理之后,输出的id就是需要重点关注的新闻集合,从输出的集合看重复新闻数量是大大的减少了!

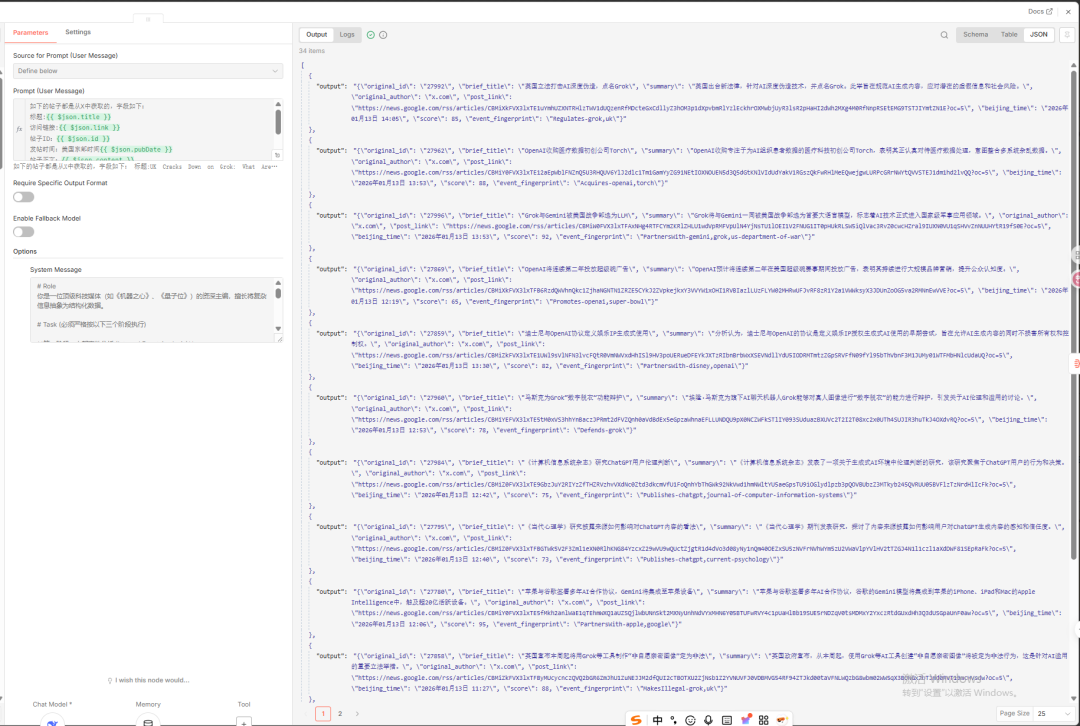

当然这里还是继续使用右边的AI Agent节点继续对左边code节点的输出结果进行处理(也包括一些剔重的操作)

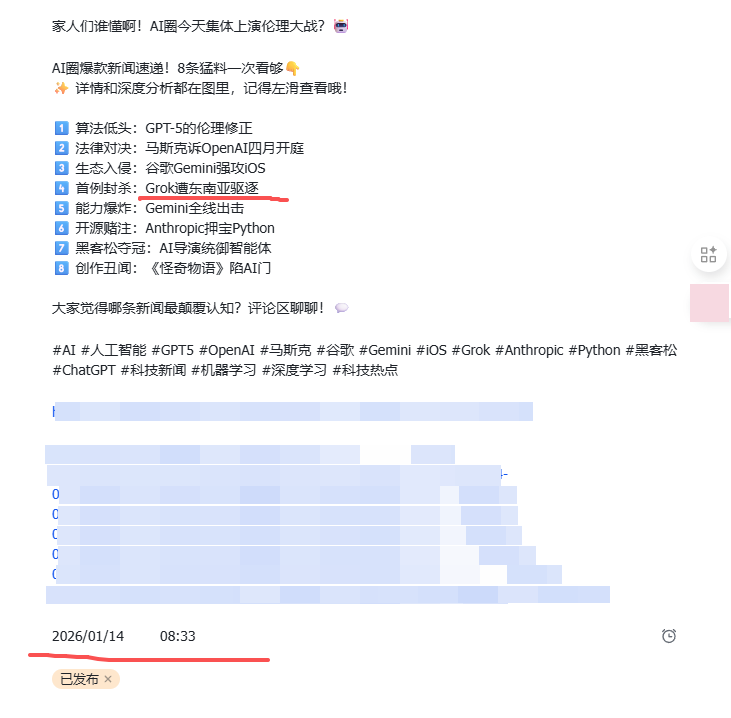

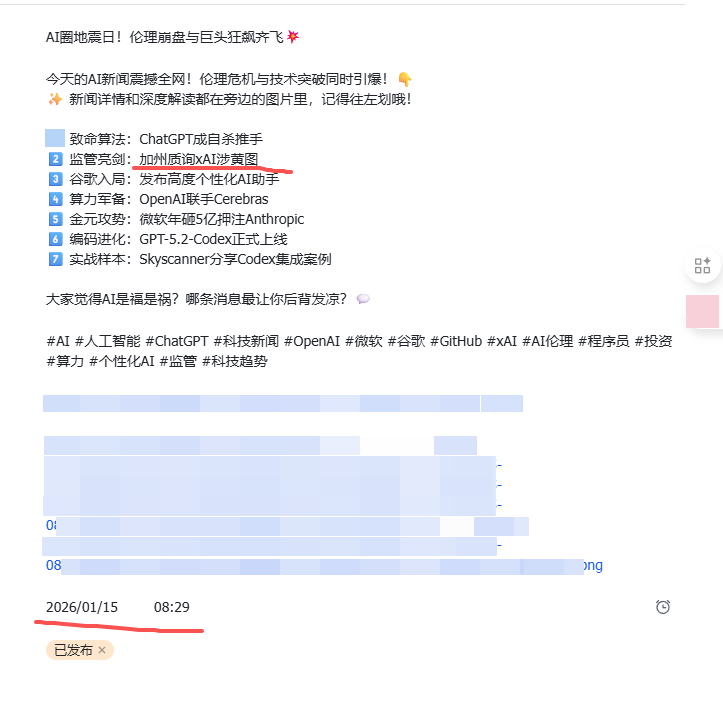

最终,体现到这2天的新闻上就是:

例如15号的新闻数据,那种霸榜的情况已经大大的改观了!

所以,最终左边这块对新闻数据的筛选,大体上我是做了这样的一些改造:a.初步筛选AI Agent(左边那个)需要提取新闻事件指纹信息;b.接着就是经过一个code节点进行过滤筛选;c.筛选后的结果交给右边的AI Agent处理,它也会再次生成新闻事件指纹,d.接着再次交给code节点处理,此时这种重复的新闻事件就基本绝迹了!

其实主要就是:ai和代码配合来,通过事件指纹这种唯一性的key实现重复数据的剔重!

03日报效果

在13号对这块的逻辑优化完之后,我观察14号、15号的执行结果,看到日报数据里面这种霸榜的情况已经没有了!

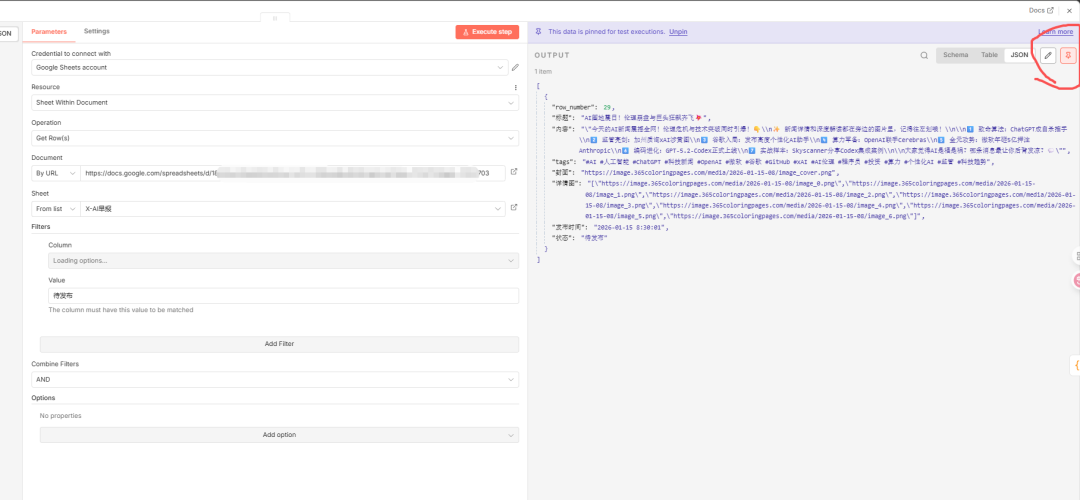

0****3****pin功能

0****3****pin功能

在对n8n的工作流的调试和问题复现过程中,n8n提供的这个数据pin功能非常有用,我在优化这个工作流时,因为像调用AI的这种功能它非常耗时也非常耗钱,所以把这些节点的输出数据pin起来,就能极大的节省时间和金钱成本!

例如:pin图标就是输出结果右上角的图钉!pin住后这个节点就相当于使用固定的返回值!在工作流中看这个节点,它的右下角也有一个小图钉!

0****4****写在最后

0****4****写在最后

好了,对于这个AI日报工作流的优化过程就分享到这里了,需要该工作流的朋友可以私聊我!

另欢迎大家来我的个人博客网站https://hellosai.cc/逛逛!关注杰哥不迷路,每天给你分享不一样的实用好工具。

***喜欢这篇干货?如果觉得不错,请帮我一键三连,转发给您的朋友,都是对我最大的鼓励与认可。如果想第一时间收到推送,可以把我的公众号加个星标🌟方便后面我们一起探讨AI或有意思的东西,还能够快速找到我!我们明天见!—END—图 | 来源网络侵删欢迎点赞,在看,转发给我鼓励~👇👇关注我👇👇👇👇扫码加入粉丝群领取福利👇👇